先日、娘のPCのグラボをようやくGTX1060から交換した。

原神くらいなら我慢できていたらしいが、鳴潮(めいちょう)になるとさすがに厳しいとのこと。

まぁ、GTX1060なんて何年前の代物かわからないレベルだし、お古とはいえ限界はある。

ただ、最近はグラボもメモリも値上がり中。

私のPCは、壊れたRTX3080の代わりに修理したRTX3060Tiを使っていたが、最近ゲームもしていなかったので娘にお下がりとして提供することにした。

ところが、娘のモニタは HDMI×1、D-sub×1、DVI-D×1。

HDMIは液タブが占有している。

RTX3060Tiは HDMIかDPのみ なのでDPを使うしかないが、変換コネクタが手元にない。

変換コネクタを買うのも面倒なので、私が使っていた34インチUWQHDモニタ(中古1万円)を娘に譲り、

私のPC環境は GTX1060+24インチFHD に逆戻り…。

グラボ物色 → RX 9060 XT にたどり着く

最初は「しばらくGTX1060でいいか」と思っていたが、調べているうちに

中古のRX 9060 XT(16GB)が6万円台で買える と判明。(数か月前なら新品5万以下もあったのに・・・)

やはりNVIDIAの16GBモデルが欲しかったのだが、 RTX 5060 Ti(16GB)は9万円コース。さすがに手が出ない。

ゲーム性能もそこそこで、16GBあればローカルAIもワンチャンいけるか?

CUDAがないので圧倒的不利なのは承知だが、

「そこそこのサイズのモデルが動くかもしれない」という誘惑に勝てなかった。

私の悪い癖で、楽しそうと思った瞬間に物欲が暴れ出す。

頭の中で言い訳をひねり出し始めた時点で、もう負けは確定。

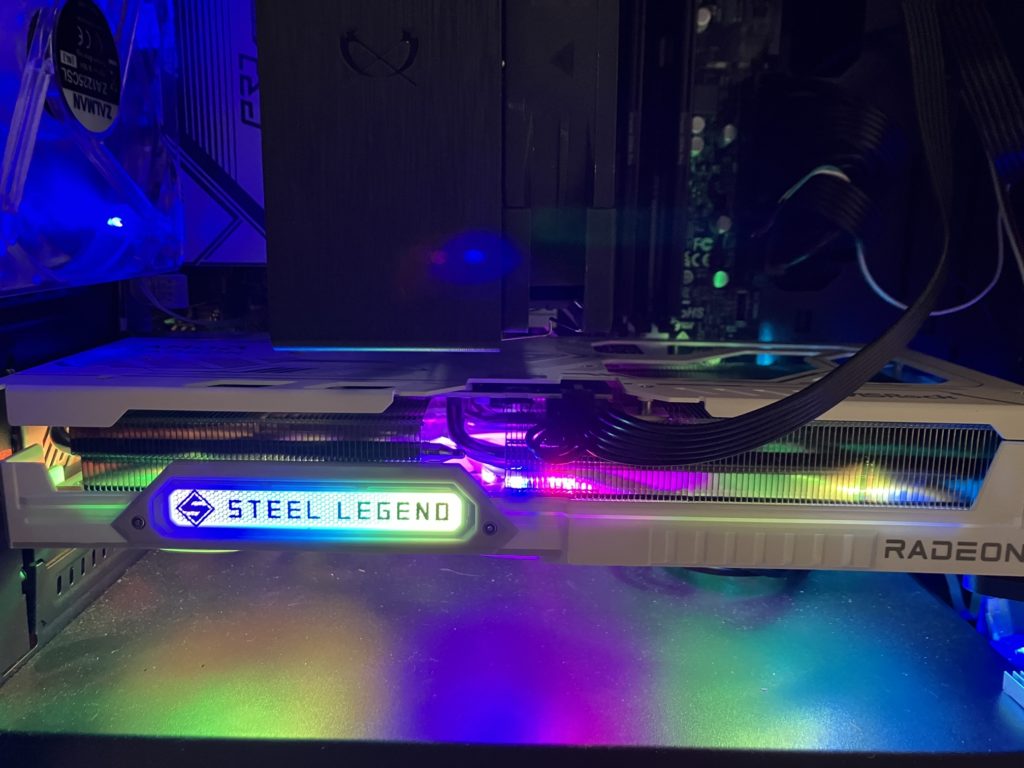

ということで、ドスパラ中古で ASRock RX 9060 XT Steel Legend 16G を

送料込み 63,560円 で購入。

こちら中古Cランクとのことだったが、届いたのは開封済みの新品か?と思うほどきれいな状態。埃も傷も無くいい状態だった、ありがとうドスパラさん。

気づけば、人生で一番高いグラボになっていた。

RTX3080ですら35,000円、RTX3060Tiは2万円(どちらもジャンク)。

GTX1060は新品だったが、それでも3万円くらいだった記憶がある。

ふと振り返ると、GPUにいくら使ってきたんだろう

結局、ゲームは大してやらないのに、

生涯で買ったGPUを全部合わせたらいくらになるのか…。

覚えているだけでも、1990年代の Matrox Millennium シリーズから始まり、

その後も4万円以内くらいのビデオカードを定期的に買ってきた。

一度買うと4~5年は使うとはいえ、積み重ねると相当な金額だ。

でも、この金額で何ができたかなんて考えない。

夢を買ったんだから、それでいい。

なぜAMDはローカルAIに向かないのか?

巷では「ローカルAIはNVIDIA一択」と言われることが多い。

その理由はシンプルで、AI技術の多くがCUDA前提で作られているからだ。

CUDAはNVIDIA製GPUで高速に汎用計算を行うための仕組みで、

AIフレームワークの最適化もほぼCUDA中心。

そのため、NVIDIA GPUはAI用途で圧倒的に有利になる。

一方、AMDにもROCmというCUDAに相当する計算基盤があるが、

Windowsではサポートされていない。

(Linuxでは使えるが、対応GPUが限られる)

そのためWindows環境では、

DirectMLやONNXといった汎用ライブラリを使うしかなく、

CUDAの最適化には到底及ばないのが現状だ。

ただし、DirectMLはLM Studioでも使われており、

AMDも最適化を進めているらしいので、

将来的にはCUDAに近い安定した性能が出る可能性もある。

とはいえ現時点では、

「AMD製GPUはローカルAI推論に向かない」

という評価が一般的だ。

AMD製GPUにも、CUDAに相当する

ROCm(AMD版CUDAとも言える汎用計算プラットフォーム)

が存在する。

せっかくの16GBモデルだし、

RTX3080や3060TiではVRAM不足で動かないサイズのLLMも、

実用的な速度で動くのか気になるし。

ROCmを使うにはLinux環境が必須とのことなので、

今回はWSL(Windows Subsystem for Linux)を使うことにした。

WSLは、VirtualBoxのような仮想化ソフトを使わずに

Windows上でLinuxを動かせる便利な仕組みだ。

ファイル共有もシームレスで、メモリ消費も少ない。

このWSL上に、ROCmが動く環境を構築していく。

コメント